En action

Limonad'IA sur vos collections

Interface de recherche sémantique

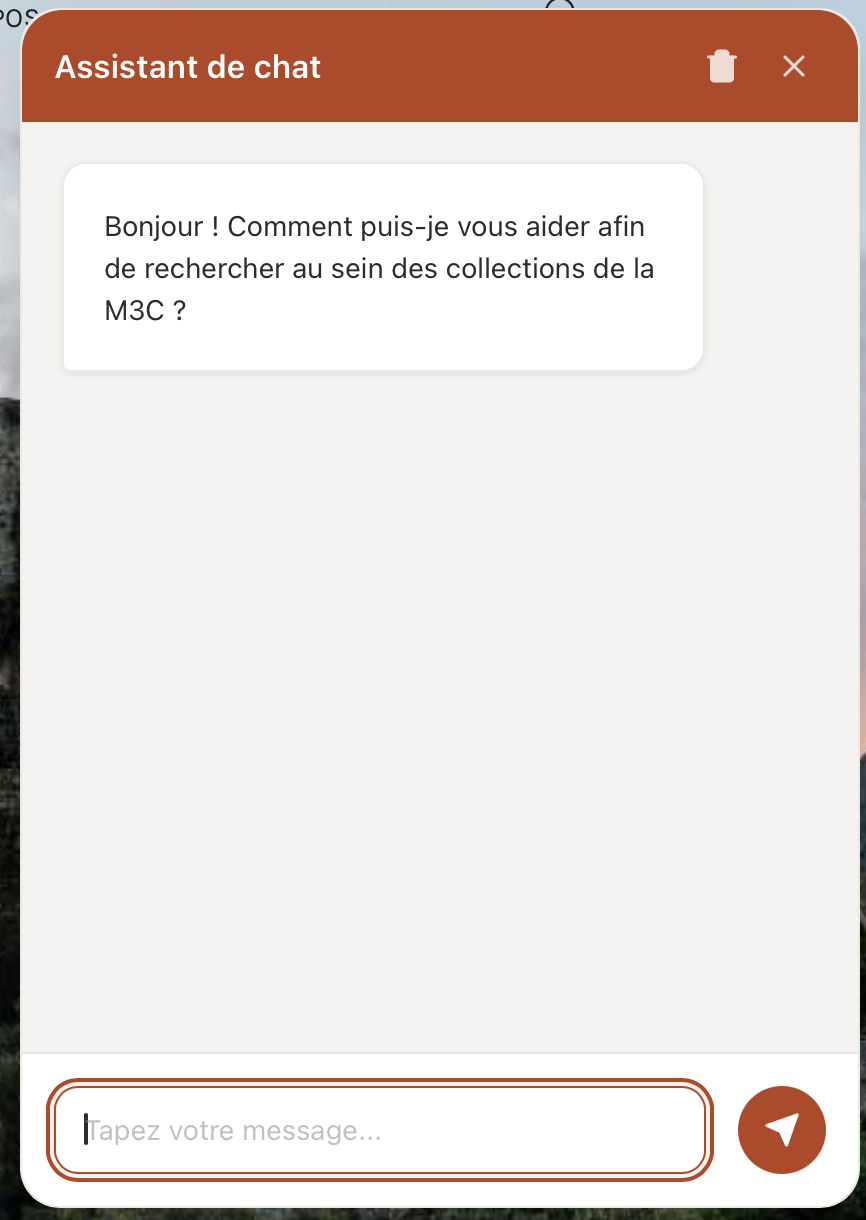

Module chatbot sur une collection patrimoniale

Résultats de recherche enrichis

Extraction de critères et génération de réponses

Panneau de configuration

Paramétrage du module et choix du modèle LLM

Tableau de bord analytique

Suivi des requêtes et des performances